一年一度的 HotChips 在美国隆重举行,作为集成电路行业的盛会,吸引了众多处理器公司展示其最新的产品和在研成果。在本次 HotChips 2024 上,AI 芯片成为了焦点。英特尔推出全集成光计算互连小芯片,NVIDIA 深入介绍 Blackwell AI 集群平台架构,Tenstorrent 展示 Blackhole AI 计算机。这些技术进步预示着 AI 芯片性能的显著提升和应用场景的扩展,为人工智能的未来提供强大动力。

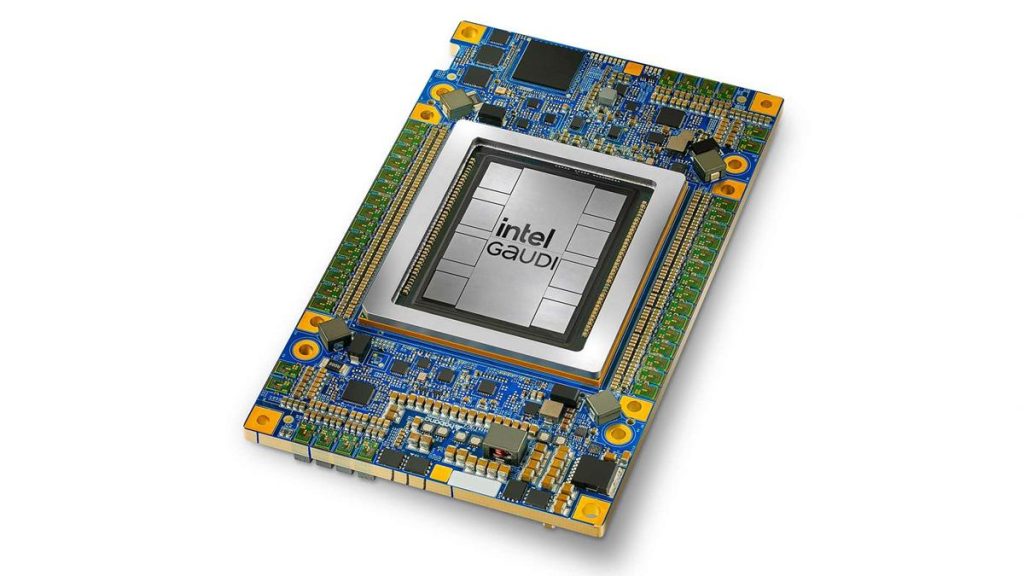

英特尔将在此次活动中展示其在 AI 架构方面的专业知识。英特尔宣布,将展示其技术在数据中心、云端、网络、边缘设备以及 AIPC 等用例方面的深度和广度,其中包括业界最先进、首个用于高速 AI 数据处理的全集成光计算互连(Optical Compute Interconnect,OCI)小芯片。在 HotChips 2024 期间,英特尔举办了四场会议,展示其 AI 架构专业知识,涉及了 Lunar Lake 处理器、Xeon 6 SoC、Gaudi 3 加速器,所有这些都通过光学计算互联的平台进步联系在一起。此外,英特尔还将公布计划 2025 年上半年推出的 Xeon 6 SoC(代号 Granite Rapids-D)的新细节。

英特尔将在此次活动中展示其在 AI 架构方面的专业知识。英特尔宣布,将展示其技术在数据中心、云端、网络、边缘设备以及 AIPC 等用例方面的深度和广度,其中包括业界最先进、首个用于高速 AI 数据处理的全集成光计算互连(Optical Compute Interconnect,OCI)小芯片。在 HotChips 2024 期间,英特尔举办了四场会议,展示其 AI 架构专业知识,涉及了 Lunar Lake 处理器、Xeon 6 SoC、Gaudi 3 加速器,所有这些都通过光学计算互联的平台进步联系在一起。此外,英特尔还将公布计划 2025 年上半年推出的 Xeon 6 SoC(代号 Granite Rapids-D)的新细节。

英特尔网络和边缘事业部首席技术官 Pere Monclus 表示:在消费者和企业 AI 使用中,英特尔不断提供重新定义可能性所需的平台、系统和技术。随着 AI 工作负载加重,英特尔广泛的行业经验使我们能够了解客户需要什么来推动创新、创造力和理想的业务成果。虽然更高性能的芯片和更高的平台带宽是必不可少的,但英特尔也知道每个工作负载都有独特的挑战:为数据中心设计的系统不能再简单地重新用于边缘。凭借在整个计算连续体的系统架构方面久经考验的专业知识,英特尔有能力为下一代人工智能创新提供动力。英特尔希望通过深入的技术探讨会议,提供来自其产品团队的独特技术观点,将下一代 AI 技术推向市场。

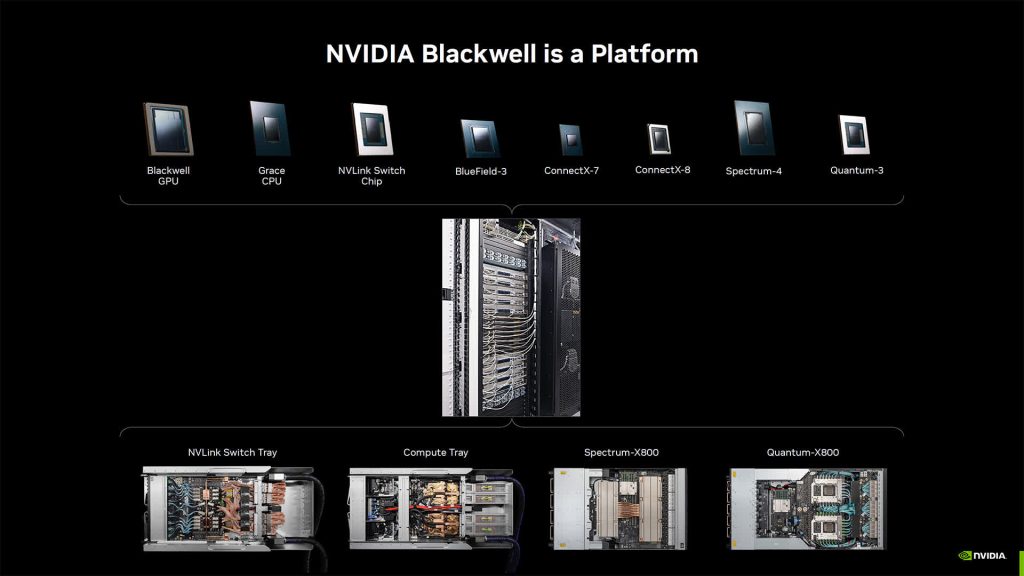

NVIDIA 在本次 HotChips 2024 上也备受关注。NVIDIA Blackwell 无疑是焦点之一,预计将在 2025 年大卖。该公司更深入地介绍了平台架构,这次谈论的不是单个 GPU,而是 AI 集群级别。这很有意义,特别是在看到来自大型 AI 商店的演讲,例如 OpenAI 在 HotChips 2024 上关于构建可扩展 AI 基础设施的主题演讲时。NVIDIA 不仅注重构建硬件集群,还注重构建具有优化库的软件。NVIDIA Blackwell 平台涵盖从 CPU 和 GPU 计算到用于互连的不同类型的网络。这是从芯片到机架和互连,而不仅仅是 GPU。GPU 非常庞大。其中一个重要功能是与 Grace CPU 连接的 NVLink-C2C。作为 NVIDIA 最新的 GPU,也是其性能最高的 GPU。NVIDIA 使用 NVIDIA 高带宽接口(NV-HBI)在两个 GPU 芯片之间提供 10TB/s 的带宽。NVIDIA GB200 Superchip 是半宽平台中的 NVIDIA Grace CPU 和两个 NVIDIA Blackwell GPU。两个并排意味着每个计算托盘有四个 GPU 和两个 Arm CPU。NVIDIA 拥有新的 FP4 和 FP6 精度。降低计算精度是提高性能的众所周知的方法。

NVIDIA 在本次 HotChips 2024 上也备受关注。NVIDIA Blackwell 无疑是焦点之一,预计将在 2025 年大卖。该公司更深入地介绍了平台架构,这次谈论的不是单个 GPU,而是 AI 集群级别。这很有意义,特别是在看到来自大型 AI 商店的演讲,例如 OpenAI 在 HotChips 2024 上关于构建可扩展 AI 基础设施的主题演讲时。NVIDIA 不仅注重构建硬件集群,还注重构建具有优化库的软件。NVIDIA Blackwell 平台涵盖从 CPU 和 GPU 计算到用于互连的不同类型的网络。这是从芯片到机架和互连,而不仅仅是 GPU。GPU 非常庞大。其中一个重要功能是与 Grace CPU 连接的 NVLink-C2C。作为 NVIDIA 最新的 GPU,也是其性能最高的 GPU。NVIDIA 使用 NVIDIA 高带宽接口(NV-HBI)在两个 GPU 芯片之间提供 10TB/s 的带宽。NVIDIA GB200 Superchip 是半宽平台中的 NVIDIA Grace CPU 和两个 NVIDIA Blackwell GPU。两个并排意味着每个计算托盘有四个 GPU 和两个 Arm CPU。NVIDIA 拥有新的 FP4 和 FP6 精度。降低计算精度是提高性能的众所周知的方法。

NVIDIA 表示,用于推理的 FP4 在某些情况下可以接近 BF16 的性能。这是使用 FP16 推理和 FP4 的图像生成任务。NVIDIA 表示 AI 模型正在不断发展。NVLink 交换芯片和 NVLink 交换 tray 旨在以比简单地使用以太网等现成解决方案更低的功率推送大量数据。NVLink 从 2016 年的 8 个 GPU 开始,到目前这一代的 72 个 GPU 都实现了这个目标。巧合的是,HotChips 30 大会上关于 16-GPU NVSwitch DGX-2 拓扑的 NVIDIA NVSwitch 细节没有被提及。NVIDIA 展示了 GB200 NVL72 和 NVL36。NVL36 是 36 GPU 版本,适用于无法处理 120kW 机架的数据中心。Spectrum-X、Spectrum-4(类似于 Marvell Teralynx 1051.2T 以太网交换机)加上 BlueField-3 为以太网上的 RDMA 网络提供了组合解决方案。GB200 NVL72 是为万亿参数 AI 设计的。随着模型尺寸的增加,在多个 GPU 之间分配工作负载势在必行。Blackwell 足够大,可以在一个 GPU 中处理专家模型。NVIDIA 正在展示 GPT-MoE 1.8T 的性能。这是新的 NVIDIA 路线图幻灯片。也许可以使用多主机,但这令人兴奋。以下是简要摘要:除了路线图幻灯片外,我们之前已经看到过很多这样的内容。与此同时,NVIDIA 不仅在构建集群,还在优化一切,包括互连、交换机芯片,甚至部署模型。AI 初创公司面临的一个挑战是,NVIDIA 不仅在制造当今的芯片、交换机、NIC 等。相反,它正在进行前沿研究,以便其下一代产品能够在集群级别满足未来模型的需求。这是一个很大的不同。

芯片工程师 Jim Keller 因其过往丰富的履历备受关注,其担任 CEO 的 Tenstorrent 在 HotChips 2024 上展示了更多关于其 Blackhole 芯片的信息。Blackhole 将提供高达 790TOPS 的计算性能(使用 FP8 数据类型)。这是 Tenstorrent AI Silicon 路线图。Blackhole 是 2023 年及以后的芯片,是对上一代 Grayskull 和 Wormhole 的重大更新。Blackhole 是一台基于以太网的独立人工智能计算机。16 个 RISC-V 核心分为 4 个集群,每个集群有 4 个。Tensix 核心位于中间,以太网位于顶部。该芯片具有 10x400Gbps 以太网和 512GB/s 的带宽。16 个大型 RSIC-V 内核可以运行 Linux。其余 752 个 RISC-V 内核被称为小型内核,可使用 C 内核进行编程,但不能运行 Linux。用户可以在每个 Tensix 核心上编写一个计算内核和两个数据移动内核。

芯片工程师 Jim Keller 因其过往丰富的履历备受关注,其担任 CEO 的 Tenstorrent 在 HotChips 2024 上展示了更多关于其 Blackhole 芯片的信息。Blackhole 将提供高达 790TOPS 的计算性能(使用 FP8 数据类型)。这是 Tenstorrent AI Silicon 路线图。Blackhole 是 2023 年及以后的芯片,是对上一代 Grayskull 和 Wormhole 的重大更新。Blackhole 是一台基于以太网的独立人工智能计算机。16 个 RISC-V 核心分为 4 个集群,每个集群有 4 个。Tensix 核心位于中间,以太网位于顶部。该芯片具有 10x400Gbps 以太网和 512GB/s 的带宽。16 个大型 RSIC-V 内核可以运行 Linux。其余 752 个 RISC-V 内核被称为小型内核,可使用 C 内核进行编程,但不能运行 Linux。用户可以在每个 Tensix 核心上编写一个计算内核和两个数据移动内核。

HotChips 2024 为我们呈现了一场 AI 芯片的创新盛宴,各大公司纷纷展示其最新成果和技术突破,为未来的人工智能发展注入了强大的动力。我们期待着这些创新能够尽快落地,为人们的生活和工作带来更多的便利和进步。